Un recente studio ha messo in luce una capacità sorprendente, e per certi versi preoccupante, dei modelli di intelligenza artificiale. Al centro della ricerca, condotta da un team di informatici e studiosi di diritto delle università di Stanford, Cornell e West Virginia, c'è il modello Llama 3.1 70B di Meta. I risultati indicano che questo modello ha "memorizzato" una porzione sbalorditiva, circa il 42 percento, del primo libro della saga di Harry Potter, "Harry Potter e la Pietra Filosofale".

Va da sè che una scoperta simile sollevi interrogativi fondamentali sulle modalità d'addestramento dell'AI e getta nuova luce sulle complesse battaglie legali che vedono contrapposte le aziende creatrici dei modelli e i detentori di copyright, come editori e autori. Il punto principe di queste dispute legali è sempre stato capire fino a che punto i modelli AI possano riprodurre testualmente contenuti protetti da diritto d'autore. Se in passato aziende come OpenAI hanno definito la riproduzione di testi come un "comportamento marginale", questo nuovo studio suggerisce una realtà ben diversa, almeno per alcuni modelli e per alcune opere.

È interessante notare come il problema della memorizzazione sembri essersi aggravato nel tempo. Il predecessore del modello attuale, Llama 1 65B, rilasciato nel febbraio 2023, aveva memorizzato solo il 4,4 percento dello stesso libro. Questo notevole aumento suggerisce che, nonostante le potenziali responsabilità legali, le strategie di addestramento adottate per i modelli più recenti abbiano intensificato, anziché mitigato, questo fenomeno. I ricercatori hanno esaminato decine di libri, scoprendo che Llama 3.1 70B tende a memorizzare molto più facilmente opere popolari, come "Lo Hobbit" o "1984" di George Orwell, rispetto a testi meno noti.

Questi dati forniscono argomenti a entrambe le parti nel dibattito sul copyright. Come mai? Perché aa un lato, i critici dell'industria AI possono ora sostenere con più forza che la memorizzazione non è un evento raro, ma un problema concreto. D'altro canto, i risultati dello studio mostrano una grande variabilità, e solo per citare un esempio, lo stesso modello ha memorizzato appena lo 0,13 percento di "Sandman Slim", un romanzo del 2009. Questa discrepanza potrebbe complicare le cause legali collettive (class action), dove si presume che i querelanti si trovino in situazioni legali e fattuali simili. Potrebbe essere difficile sostenere che autori come J.K. Rowling e Richard Kadrey abbiano subito lo stesso tipo di danno.

La ricerca introduce anche riflessioni importanti sulle diverse teorie di violazione del copyright. Una prima teoria sostiene che l'addestramento stesso sia una violazione, poiché implica la copia digitale dell'opera. Una seconda vede il modello AI come un'"opera derivata" che incorpora parti del materiale originale. La terza si concentra sull'infrazione che avviene quando il modello genera output che riproducono l'opera. La capacità di Llama 3 di rigurgitare porzioni così ampie di un'opera famosa potrebbe indebolire la difesa basata sul "fair use" (uso legittimo), specialmente per la seconda teoria.

Se un modello contiene di fatto una copia sostanziale di un libro, diventa più difficile per un'azienda come Meta sostenere di aver semplicemente "imparato" dei modelli linguistici in modo trasformativo. La questione, quindi, è tutt'altro che filosofica e richiederà analisi empiriche sempre più dettagliate per essere risolta in tribunale.

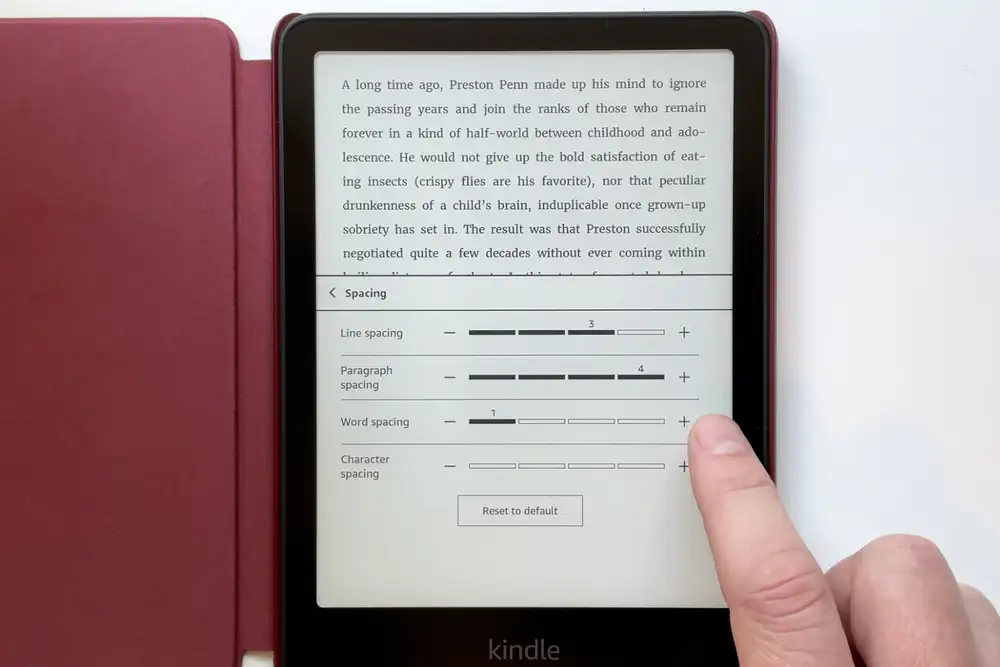

Amazon improves Kindle accessibility with new text spacing adjustments

Amazon improves Kindle accessibility with new text spacing adjustments